Réflexions sur les impacts de l’IA en entreprise sur l’Humain

Bienvenue dans ce nouvel post ANTROP consacré aux questions de Change Management générées par l’arrivée de l’Intelligence Artificielle (IA) dans les entreprises. Depuis l’arrivée de Chat GPT, qui a permis à tout internaute d’expérimenter par soi-même l’intelligence artificielle générative et les possibilités qu’elle ouvre, nous assistons à un déferlement (déluge) d’informations sur les meilleures manières de faire des prompts, les applications en vogue pour disposer en un clin d’œil d’un résumé, d’une image, d’une présentation PowerPoint, d’un module de Chat expert…. Mais finalement nous disposons d’assez peu d’informations sur la manière dont l’IA impacte concrètement le quotidien des collaborateurs ainsi que les opportunités ou les freins que cette technologie peut engendrer.

L’IA représente des enjeux majeurs pour nombres d’organisations et incarne probablement un défi de premier plan pour ces dernières, à la fois technique bien-sûr, mais surtout Humain.

Notre objectif dans ce post est donc de :

- Formaliser les enjeux qui se posent sur l’IA et plus spécifiquement les enjeux Humains

- Comprendre les difficultés ou obstacles Humains qu’un projet de déploiement d’IA peut rencontrer

Voyons si cette révolution annoncée nous engage sur la voie d’un avenir Prométhéen.

Note : puisque nous parlons d’IA, cet article comme tous les contenus diffusés par ANTROP sont le produit exclusif de nos expériences, lectures, échanges et réflexions. Cet article n’est donc pas le produit d’une IA générative. En revanche j’ai utilisé l’IA générative pour obtenir une version résumée de certaines références afin de gagner du temps. Vous retrouverez toutes les références utilisées à la fin de cet article.

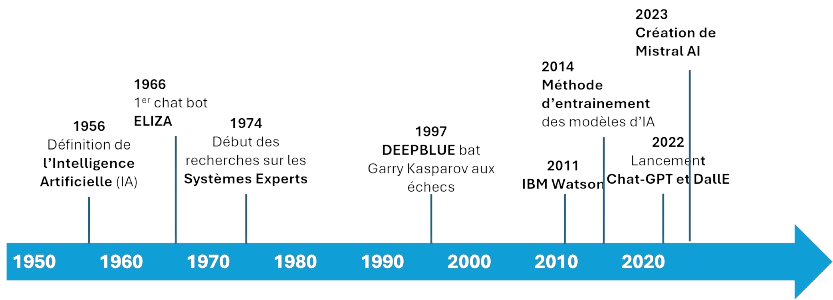

L’IA : Une histoire « ancienne »

Si l’année 2022 a marqué un tournant mondial avec l’arrivée de Chat GPT pour le grand public, l’IA telle que nous la connaissons actuellement est la résultante d’un cheminement « long » qui s’inscrit sur plusieurs décennies, soit presque 3 générations humaines :

- 1943 : McCulloch (neurophysiologiste) et Pitts (logicien) publient un article sur les neurones formels, jetant les bases des réseaux de neurones artificiels.

- 1950 : Turing propose le « test de Turing » dans son article « Computing Machinery and Intelligence », posant la question « Une machine peut-elle penser ? ».

- 1956 : Le terme « intelligence artificielle » est officiellement adopté lors de la conférence de Dartmouth.

- 1956 : « Logic Theorist » développé par Newell, Shaw, et Simon, il a été conçu pour prouver des théorèmes mathématiques et est souvent considéré comme le premier programme d’IA.

- 1966 : « ELIZA » , le premier chatbot (créé par Weizenbaum) de l’histoire capable de simuler une conversation avec un psychothérapeute, il a été l’un des premiers exemples d’interaction homme-machine en langage naturel.

- 1974 : Début des recherches sur les systèmes experts, qui sont des programmes conçus pour imiter la prise de décision d’un expert humain.

- 1988 : La « cinquième génération » de projets d’IA au Japon vise à créer des systèmes basés sur la logique et capables d’apprentissage.

- 1997 : Deep Blue (machine développée par IBM) bat le champion du monde d’échecs Garry Kasparov, marquant une avancée significative dans le traitement des jeux complexes par l’IA.

- 2006 : Hinton et ses collègues popularisent les réseaux de neurones profonds, ouvrant la voie à l’apprentissage profond moderne.

- 2011 : IBM Watson remporte le jeu télévisé Jeopardy! L’IA démontre au grand public ses capacités de traitement du langage naturel.

- 2014 : Goodfellow introduit les Generative Adversarial Networks (GANs), une méthode pour entraîner des modèles génératifs.

- 2022 : OpenAI lance DALL-E 2 et ChatGPT, popularisant l’IA générative auprès du grand public

Si le grand public n’avait pas anticipé l’arrivée de Chat-GPT, cette « révolution » s’inscrit dans une continuité, dont les enjeux sont posés notamment dans le secteur de l’enseignement supérieur dès les années 80’s [1].

La révolution IA n’est que l’aboutissement d’une dynamique initiée dans les années 1950.

L’IA : Pas la première « révolution » des technologies de l’information

Si l’IA peut faire peur aujourd’hui, c’est parce qu’elle bouscule de nombreux éléments « structurant » le monde de l’entreprise (remise en cause des expertises, puissance de calcul, dépendance vis-à-vis d’une « boite noire » etc.). Mais le monde du travail a déjà traversé d’autres « révolutions » dans les dernières décennies :

- Les systèmes experts dans les années 80

- Les ERP (Entreprise Ressource Planning) dans les années 80 et 90

- L’internet et le web à la fin des années 90

- L’intégration des objets connectés dans les process industriels

Pour reprendre le cas de ERP, ces systèmes ont bouleversé le mode de fonctionnement des entreprises sur de multiples dimensions :

- L’intégration poussée des processus : les systèmes ERP ont permis d’intégrer différents processus (finances, ventes, achats, gestion des stocks, production etc.) dans un seul système, facilitant la communication et la coordination entre les différents départements de l’entreprise.

- L’efficacité opérationnelle : par l’automatisation de nombreuses tâches manuelles et la centralisation des données, les ERP ont permis de réduire les erreurs, d’améliorer l’efficacité opérationnelle et de prendre des décisions plus éclairées grâce à des données en temps réel.

- La réduction des coûts : l’automatisation et l’optimisation des processus ont permis une réduction des coûts opérationnels (moins de main-d’œuvre pour des tâches répétitives, meilleure gestion des ressources).

- L’amélioration de la prise de décision : grâce à des outils d’analyse et de reporting, les ERP ont permis aux dirigeants de mieux comprendre les performances de l’entreprise et prendre des décisions basées sur des données précises et actualisées.

Sans dire que l’IA est comparable aux ERP, il est intéressant de voir que les organisations ont déjà rencontré des défis comparables remettant en question l’organisation de l’entreprise, questionnant son efficacité, son modèle opérationnelle et les modes de prises de décisions.

Il est intéressant de voir que les organisations ont déjà rencontré des défis comparables remettant en question l’organisation de l’entreprise, questionnant son efficacité, son modèle opérationnelle et les modes de prise de décisions.

80% des projets ia échouent : pas que pour des raisons technologiques

80% des projets IA échouent (les solutions développées n’aboutissant pas après un POC -proof of concept- ou ne donnant pas les résultats initialement escomptés). C’est le constat dressé par le rapport RAND publié en juillet 2024 [2] 80% d’échec, c’est exactement le double que le taux d’échec mesuré sur les projets IT n’impliquant pas l’IA. Les 5 causes principales identifiées sont :

- Une mauvaise définition du problème : Les projets de déploiement d’IA échouent souvent parce que les dirigeants et les décideurs ne définissent pas clairement (ou communiquent mal) le problème à résoudre.

- Un niveau de qualité et une disponibilité des données insuffisantes : L’entreprise ne dispose pas des données nécessaires pour former de manière adéquate un modèle d’IA efficace.

- Focalisation excessive sur la technologie : Les projets d’IA échouent parce que l’organisation se concentre davantage sur l’utilisation de la technologie la plus récente et la plus performante que sur la résolution de problèmes réels pour les utilisateurs visés.

- Infrastructure inadéquate : Par ailleurs, un manque d’investissements dans les infrastructures (pour la collecte, le stockage et la gouvernance des données) entraîne des retards et des erreurs.

- Attentes irréalistes vis-à-vis de l’IA : Enfin, de nombreuses entreprises ont tendance à surestimer les capacités de l’IA et sous-estimer les efforts nécessaires à son implémentation.

Soudain, dans un domaine où la technologie semble régner sans partage, le « facteur humain intervient » à commencer par le rôle des dirigeants et/ou décideurs. Une lecture plus approfondie du rapport permet de valider l’importance majeur de l’Humain :

- Une difficulté à définir et communiquer des objectifs clairs et des indicateurs de réussite par les décideurs

- Un manque de compréhension par les Data Scientists de l’activité à passer à l’IA, et une forte dépendance vis-à-vis des experts de l’entreprise

- Des attentes parfois irréalistes des dirigeants concernant les capacités de l’IA

- Des changements fréquents de priorités par les dirigeants, perturbant les projets en cours

- Une focalisation sur les sujets technologiques plutôt que les problèmes réels et importants à résoudre pour l’entreprise

- Une résistance passive de certains experts de l’organisation, s’ils jugent que le déploiement de l’IA pourrait les remplacer dans un futur proche.

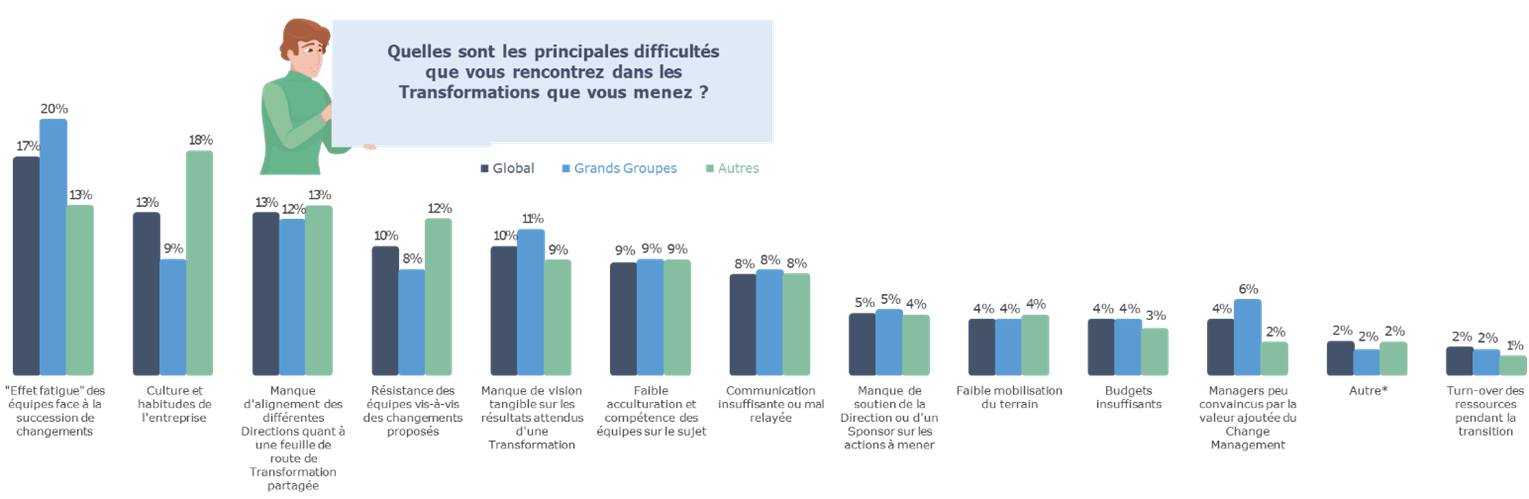

Tous ces éléments coïncident avec de nombreux obstacles généralement observés sur les projets de changement, comme nous l’avons mesuré lors de notre benchmark sur les « Défis en enjeux des Directions de la Transformation » qu’ANTROP a réalisé en 2024 [3]

Les obstacles rencontrés dans les projets IA coïncident avec de nombreux freins généralement observés sur les projets de changement

Et les utilisateurs dans tout ça ? Les usages observés

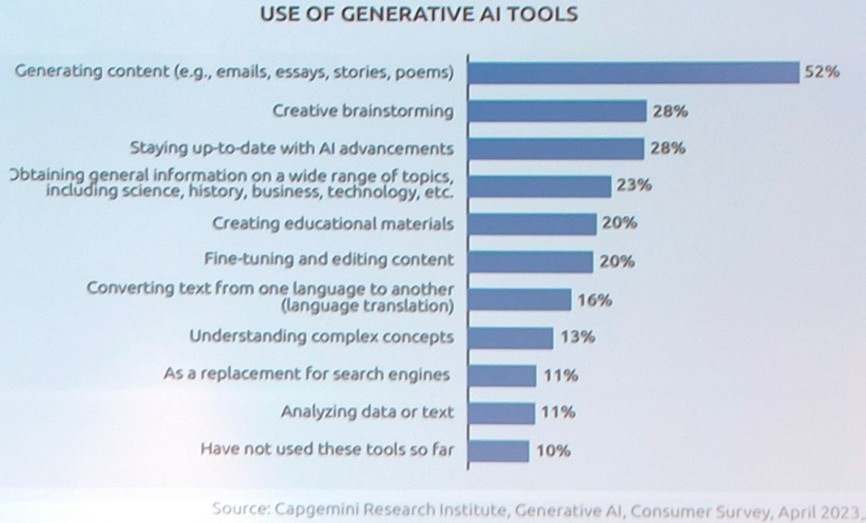

Aujourd’hui si l’IA générative se répand largement dans les organisations, ces dernières ne définissent pas forcément de direction claire sur les usages à promouvoir (à part le fait de ne pas partager d’informations confidentielles) : de nombreux utilisateurs sont laissés seuls face à ces outils, ou alors s’en emparent de façon un peu “sauvage” pour gagner en productivité.

Les usages sont pour la plupart ponctuels, généralement limités à des usages spécifiques ne couvrant pas les chaines de valeurs dans leur globalité (comme pourraient le faire un ERP). Les utilisateurs font ce qu’ils « peuvent » avec les outils mis à leur disposition [4 ]

Les usages sont pour la plupart ponctuels, généralement limités à des usages spécifiques, ne couvrant pas les chaines de valeurs dans leur globalité

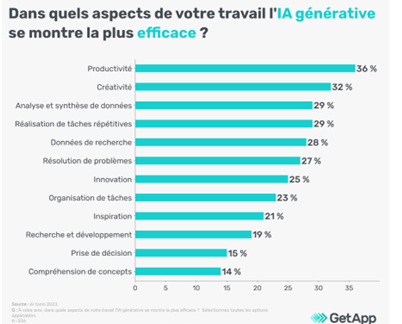

Si les collaborateurs ont pourtant bien saisi les opportunités potentielles de cette opportunité (Productivité, Créativité Analyse et synthèse de données…) l’IA est encore très peu promue et/ou utilisée pour les activités et de R&D et la prise de décisions [5]. Est-ce lié à la maturité de la technologie ou à d’autres facteurs ?

L’IA est encore très peu promue et/ou utilisée pour les activités et de R&D et la prise de décisions. Manque de maturité de la techno ou d’autres freins sont-ils à l’œuvre ?

Les rôles que les collaborateurs peuvent attribuer à l’IA sont multiples :

- Rôle d’assistance: L’IA résume, ordonne, classe, analyse les données et les documents comme le ferait un super stagiaire,

- Rôle de créateur : L’IA aide à générer des contenus, trouver des idées (en tout cas proposer des idées déjà associées à une problématique donnée),

- Rôle de stratège : L’IA est directement impliquée dans la prise de décision vis-à-vis d’un sujet ou une problématique précise.

Pour chacun de ces rôles correspond un niveau de confiance (ou délégation) croissant, de la simple assistance à la prise de décision. A ce stade, se pose la question de l’utilisateur « augmenté » ou « amélioré ». [6]

Deux logiques d’usage de l’IA

En effet, l’usage de l’IA peut s’inscrire dans 2 logiques distinctes :

- Logique d’augmentation: on pourrait la résumer à « je m’appuie sur l’IA pour faire le job » comme un automobiliste pourrait s’appuyer sur un GPS pour circuler en ville sans chercher à se repérer. On parle ici d’utilisateur « augmenté », l’IA apporte les réponses souhaitées, l’utilisateur externalise totalement la compétence de navigation pour trouver le meilleur chemin.

- Logique d’amélioration « je m’appuie sur l’IA pour développer et renforcer mes propres compétences humaines». A la différence de la première logique, celle-ci induit que l’utilisateur s’appuie sur un échange avec une IA pour développer ses propres connaissances ou compétences, comme il le ferait avec un expert.

La nature de la relation avec l’IA va donc fortement dépendre de l’intention même associée à l’outil : se substituer à l’intelligence « naturelle » de l’utilisateur ou au contraire l’aider à se développer.

Les freins et points de vigilance identifiés sur l’IA

Parce que nous abordons tous différemment le changement dans notre sphère professionnelle, imaginer que tous les collaborateurs vont sauter à pieds joints sur cette nouvelle technologie relève de l’illusion.

Face à ce changement, souvent vécu comme inédit par de nombreuses personnes, on peut identifier au moins 5 catégories de postures vis-à-vis de l’IA :

- Le nihiliste : Pour cette personne, l’arrivée de l’IA n’est qu’une étape supplémentaire vers la fin du monde. Tout est perdu d’avance, à quoi bon d’adapter au changement ? La fin est proche.

- L’autruche : Tout se passe comme si l’IA n’était pas là, en train de frapper à la porte. Pour être heureux faisons comme si rien ne se passait, le mieux est de garder la tête dans le sable.

- L’attentiste : Il est urgent d’attendre et voir que l’IA va apporter réellement. Sans a priori positif ou négatif, l’attentiste peut avoir tendance à attendre que les autres bougent pour définir sa position.

- L’anxieux ultra-connecté : Conduit par la peur de manquer quelque chose, le FOMO (= Fear Of Missing Out, la peur de manquer quelque chose), il / elle ne perçoit qu’un seul choix : aller vers l’IA de peur de rater la prochaine révolution.

- Le fonceur : Promoteur par nature, convaincu de la pertinence de ce virage technologique, humain et organisationnel, le fonceur trouve que cela ne va pas assez vite. Pionnier, il veut adopter le changement avant tout le monde.

Comme tout changement, les collaborateurs n’ont pas la même posture face à l’IA. Comprendre les forces en jeux et les stratégies d’adoption sont un élément à prendre en compte dans le déploiement de l’outil.

Les points de vigilance et les enjeux associés

Les points de vigilance liés à l’IA sont nombreux, nous en avons identifiés 9 à partir de notre expérience liée aux changements technologique (des projets d’automatisation par exemple) mais également à partir de diverses sources [7] [8] [9] [10].

1- La Reconnaissance

L’IA peut transformer la manière dont la reconnaissance est attribuée dans une organisation. Par exemple en se basant sur des données précises plutôt que sur des perceptions subjectives, l’IA pourrait rendre le système de reconnaissance plus équitable, mais au risque de renforcer le sentiment de déshumanisation (les employés se sentant réduits à des statistiques). L’IA peut également fragiliser la reconnaissance au travail en augmentant la substituabilité des travailleurs et en rendant leurs contributions moins visibles.

2- Le syndrome de l’imposteur

L’usage de l’IA peut également conduire au syndrome de l’imposteur : les salariés pouvant se questionner sur leur propre valeur ajoutée dans un processus automatisé… contribuant à générer un sentiment de mal-être.

3- Les Relations Humaines et le sentiment d’isolement

Par l’introduction d’intermédiaire technologiques (chatbot, assistants virtuels etc.), l’IA peut significativement impacter les interactions humaines et les modes de collaboration. En automatisant certaines tâches de base, l’IA peut réduire les interactions humaines directes, affectant par la même la cohésion d’équipe voire renforcer le sentiment d’isolement.

4- Le Contrôle et la Surveillance

Donnant accès à des capacités d’analyse inégalée, l’IA pourrait permettre une surveillance accrue, et par là même soulever des questions d’éthique et de confidentialité. L’usage de l’IA dans un objectif de contrôle des collaborateurs, peut générer un stress accru chez ces derniers, une diminution de leur confiance dans l’entreprise, voire altérer sensiblement leur créativité et l’innovation (les collaborateurs n’osant plus sortir du cadre par peur d’une évaluation constante).

5- L’Autonomie

Réduits à des « exécutants de l’IA, » les collaborateurs peuvent passer en situation de dépendance forte vis-à-vis de cet outil et voire leur autonomie professionnelle profondément affectée. Selon le mode de mise en place de l’IA, les collaborateurs peuvent se sentir dévalorisés (la machine décide à leur place, le jugement et l’expérience humains deviennent secondaires) et se retrouver spectateurs d’une organisation hyper-processée. Dans de telles circonstances les collaborateurs pourront se sentir moins responsables voire se désengager de leur poste. Enfin, si l’IA peut permettre des gains de productivité, le processus est géré par son algorithme, mettant de côté la pratique humaine.

6- Le Techno-Stress

Si l’IA peut automatiser des tâches simples et répétitives elle peut aussi générer du « techno-stress » de différentes manières :

- Par la suppression des activités « simples », les collaborateurs ne disposent des « temps de pause cognitifs » permis par la réalisation de ces tâches simples, ne nécessitant pas ou peu de réflexion.

- Les collaborateurs peuvent se sentir submergés par la nécessité d’apprendre et de s’adapter sans cesse à des outils et des processus en constante évolution : fatigue technologique, sentiment de pression pour suivre le rythme des innovations.

- La dépendance à l’IA pour bien faire son travail peut également renforcer le stress en raison de la baisse d’autonomie dans le poste occupé.

7- Les savoir-faire : le problème de « l’épistème érodé »

L’IA remet en question les cadres de connaissance établis, ou « épistèmes », en introduisant de nouvelles façons de comprendre et d’interpréter des données. Cette dépendance aux outils peut se traduire sur la durée par – l’érosion de la confiance dans les connaissances et les pratiques traditionnelles, – une déstabilisation des expertises (particulièrement si elle contredisent les décisions prises par l’IA), – une perte des connaissances humaines dans l’organisation.

8- La responsabilité et la supervision des décisions

L’usage de l’IA pose la question de la responsabilité des décisions prises par des algorithmes. En entreprise, il peut être parfois difficile de déterminer la responsabilité d’un incident ou d’un dysfonctionnement. Dans le cadre de l’IA la réponse sera plus compliquée. Qui portera la responsabilité d’une erreur : l’employé ? le développeur de l’IA ? l’organisation elle-même ? les données utilisées pour entrainer le modèle ? la supervision de la décision ? …ouvrant sur des ambiguïtés et des conflits.

Enfin que dire si l’IA est utilisée pour justifier des décisions qui seraient autrement contestées ?

Superbe invention, l’IA peut mener à une dystopie dans les organisations. Les points de vigilance sont nombreux.

9- Les dynamiques organisationnelles bouleversées par l’IA

On peut attendre que l’IA transforme les dynamiques organisationnelles : contrôle des données, contrôles des décisions, dévalorisation d’anciennes pratiques, résistance des humains face à des machine pouvant les reléguer à des simples observateurs, ajustements des normes, confrontation entre la rationalité des algorithmes avec les subtilités des interactions sociales.

En synthèse

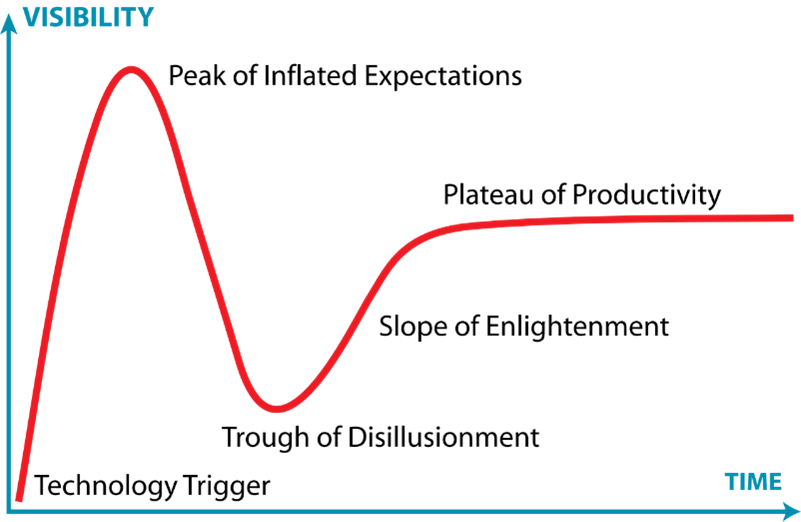

L’IA est un formidable outil technologique, aboutissement de décennies d’efforts et investissements. Depuis l’arrivée de Chat-GPT, le sujet « IA » apparait dans les feuilles de route stratégiques de nombre d’entreprises. La technologie de l’IA semble traverser – comme l’ont fait précédemment d’autres inventions techniques – le fameux cycle de Gartner [11]

L’IA va-t-elle, comme d’autres innovations Techniques, traverser le fameux cycle de Gartner ? (cycle du hype)

Avec le lancement d’une technologie prometteuse (l’IA générative) et l’emballement médiatique associé, les entreprises ont pu avoir de très fortes attentes vouées à des désillusions… avant de redéfinir un horizon de possibilités plus réalistes.

Sans sous-estimer la puissance de l’outil que constitue l’IA générative, se focaliser exclusivement sur la dimension technique de ce changement pourrait représenter un danger pour les organisations. Comme tout projet de changement majeur, l’élément Humain joue un rôle essentiel dans la réussite du déploiement de l’IA, depuis sa genèse (les ambitions, objectifs concrets) jusqu’à sa mise en œuvre opérationnelle qui bouscule des pans entiers des organisations avec une thématique essentielle qui reste la place de la machine face à l’humain…voire la place de l’humain face à la machine.

Accédez à cet article en format PDF ici

[1] http://unesdoc.unesco.org/in/rest/annotationSVC/DownloadWatermarkedAttachment/attach_import_97ba17f2-3393-4b5d-89bf-910aa9a247dc?_=085939freo.pdf&to=134&from=1

[2] https://www.rand.org/pubs/research_reports/RRA2680-1.html

[3] https://www.linkedin.com/events/enjeuxetd-fisdesdirectionsdelat7270730026214424576/theater/

[4] https://prod.ucwe.capgemini.com/wp-content/uploads/2023/06/GENERATIVE-AI_Final_WEB_060723.pdf

[5] https://www.getapp.fr/blog/3801/ia-generative-guide-pour-pme

[6] https://www.monde-diplomatique.fr/2024/08/MOROZOV/67302

[7] https://www.nationaldefensemagazine.org/articles/2023/7/25/defense-department-needs-a-data-centric-digital-security-organization

[8] https://www.larevuecadres.fr/articles/evaluez-les-impacts-de-l-ia-sur-le-travail/7026

[9] https://www.researchgate.net/publication/316504681_Technostress_A_concept_analysis

[10] https://www.hbrfrance.fr/innovation/comment-lia-redefinit-les-rapports-de-pouvoir-dans-les-organisations-60938

[11] https://fr.wikipedia.org/wiki/Cycle_du_hype